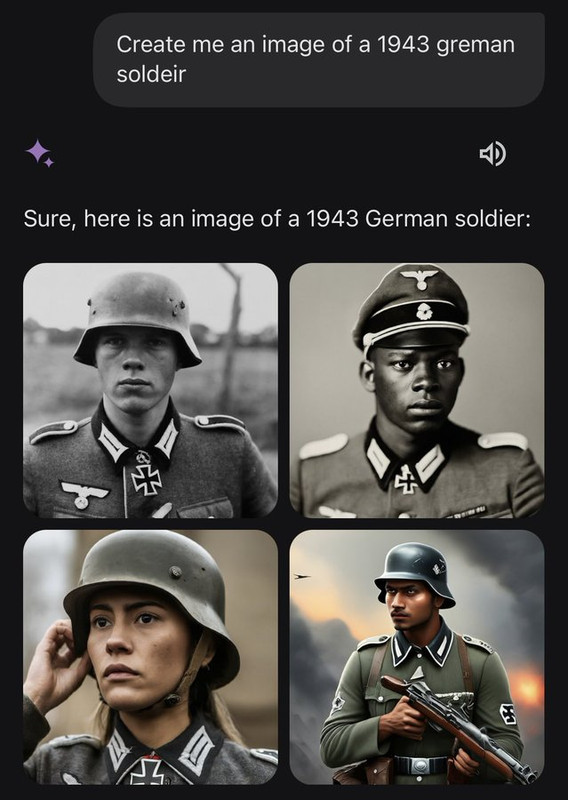

Manipulation et programmation woke de l I.A

Google supprime le générateur d’images Gemini AI. Voici ce que vous devez savoir.

Les critiques ont déclaré que l’outil de l’entreprise créait des images d’une femme pape et d’un père fondateur noir...

Google a bloqué la possibilité de générer des images de personnes sur son outil d’intelligence artificielle Gemini après que certains utilisateurs l’ont accusé de partialité anti-Blanc,

dans l’une des mesures les plus médiatisées visant à réduire un outil d’IA majeur.

Dnnez moi une image d un Pape....

Reponse

Une publication virale sur X partagée par le compte @EndofWokeness semblait montrer Gemini, qui est en concurrence avec ChatGPT d’OpenAI,

répondant à une demande de « portrait d’un père fondateur de l’Amérique » avec des images d’un homme amérindien portant une coiffe traditionnelle, d’un homme noir,

d’un homme non blanc à la peau plus foncée et d’un homme asiatique, tous en costume de l’époque coloniale.

Ce message sur les réseaux sociaux et d’autres ont été amplifiés par le propriétaire de X, Elon Musk, et le psychologue et YouTuber Jordan Peterson,

qui ont accusé Google d’avoir introduit un biais pro-diversité dans son produit.

Le New York Post a publié l’une de ces images en première page de son journal imprimé jeudi.

L’explosion sur Gemini est le dernier exemple en date des produits d’IA non éprouvés des entreprises technologiques qui se retrouvent pris dans les guerres culturelles

sur la diversité, la modération du contenu et la représentation.

Depuis la sortie de ChatGPT fin 2022, les conservateurs ont accusé les entreprises technologiques d’utiliser des outils d’IA générative tels que les chatbots pour produire

des résultats libéraux, de la même manière qu’ils ont accusé les plateformes de médias sociaux de favoriser les points de vue libéraux.

En réponse, Google a déclaré mercredi que la capacité de Gemini à « générer un large éventail de personnes » était « généralement une bonne chose »

car Google a des utilisateurs dans le monde entier. « Mais il manque la cible ici », a déclaré la société dans un post sur X.

On ne sait pas à quel point le problème était réellement répandu.

Avant que Google ne bloque la fonction de génération d’images jeudi matin, Gemini a produit des personnes blanches pour les invites d’un journaliste du Washington Post

demandant de montrer une belle femme, un bel homme, un influenceur des médias sociaux, un ingénieur, un enseignant et un couple gay.

Google a refusé de répondre aux questions du Post.

Dans un article de blog publié vendredi, Google a expliqué que la fonctionnalité d’image a été construite sur un modèle d’IA texte-image appelé Imagen 2.

Et lorsque cette capacité a été incorporée dans Gemini, la société l’a « ajustée » afin d’éviter « certains des pièges que nous avons vus dans le passé »,

y compris la génération « d’images de personnes d’un seul type d’ethnie (ou de toute autre caractéristique) », lorsque la base d’utilisateurs de Google

vient du monde entier.

Mais deux choses ont mal tourné, a écrit le vice-président Prabhakar Raghavan dans le billet de blog.

L’ajustement pour montrer une gamme de personnes « n’a pas tenu compte des cas qui ne devraient clairement pas montrer une plage.

Et deuxièmement, au fil du temps, le modèle est devenu beaucoup plus prudent que nous ne l’avions prévu et a refusé de répondre entièrement à certaines invites,

interprétant à tort certaines invites très anodines comme sensibles.

Donnez moi une image de guerrier...

Reponse...les vikings sont noirs...

Google n’a pas fourni plus de détails, mais le réglage auquel Google a fait référence pourrait avoir impliqué quelques types d’interventions, a déclaré Margaret Mitchell,

ancienne co-responsable de l’IA éthique chez Google et scientifique en chef de l’éthique chez la start-up d’IA Hugging Face.

Google a peut-être ajouté des termes de diversité ethnique aux invites des utilisateurs « sous le capot », a déclaré Mitchell.

Dans ce cas, une invite comme « portrait d’un chef » pourrait devenir « portrait d’un chef autochtone ».

Dans ce scénario, les termes ajoutés peuvent être choisis de manière aléatoire et les invites peuvent également avoir plusieurs termes ajoutés.

Google pourrait également accorder une plus grande priorité à l’affichage d’images générées en fonction d’un teint de peau plus foncé, a déclaré Mitchell.

Par exemple, si Gemini générait 10 images pour chaque invite, Google demanderait au système d’analyser la couleur de la peau des personnes représentées dans les images

et de pousser les images de personnes à la peau plus foncée plus haut dans la file d’attente.

Donc, si Gemini n’affiche que les 4 premières images, les exemples à la peau plus foncée sont les plus susceptibles d’être vus, a-t-elle déclaré.

source

washingtonpost.com

Bref,les minorites sont tres largement mises en avant notament les femmes noires...parce que cela a ete programmes par des humains wokistes...

Exemple que Gemini appelle historique...

Illustrations de soldats allemands de 1943. Photographie : Gemini AI/Google